En un momento en que los modelos de inteligencia artificial se convierten en un commodity, una nueva startup emerge para construir la capa de software que los conecta. Se trata de Osaurus, un servidor LLM de código abierto diseñado exclusivamente para el ecosistema Apple. Su propuesta es clara: permitir que los usuarios transiten entre diferentes modelos de IA locales o en la nube, manteniendo sus archivos, herramientas y memoria en su propio hardware.

El proyecto nació de la idea de un asistente de escritorio llamado Dinoki, descrito por su cofundador Terence Pae (exingeniero en Tesla y Netflix) como una especie de “Clippy potenciado por IA”. Los clientes de Dinoki cuestionaron por qué debían pagar por tokens si ya adquirían la aplicación. Esa pregunta llevó a Pae a explorar la ejecución local de modelos de IA.

“Así es como comenzó Osaurus”, explicó Pae durante una entrevista. “La idea era ejecutar un asistente de IA completamente en local. Puedes hacer casi todo en tu Mac de manera local: navegar archivos, acceder al navegador, modificar configuraciones del sistema. Queríamos posicionar Osaurus como una IA personal para cada individuo”.

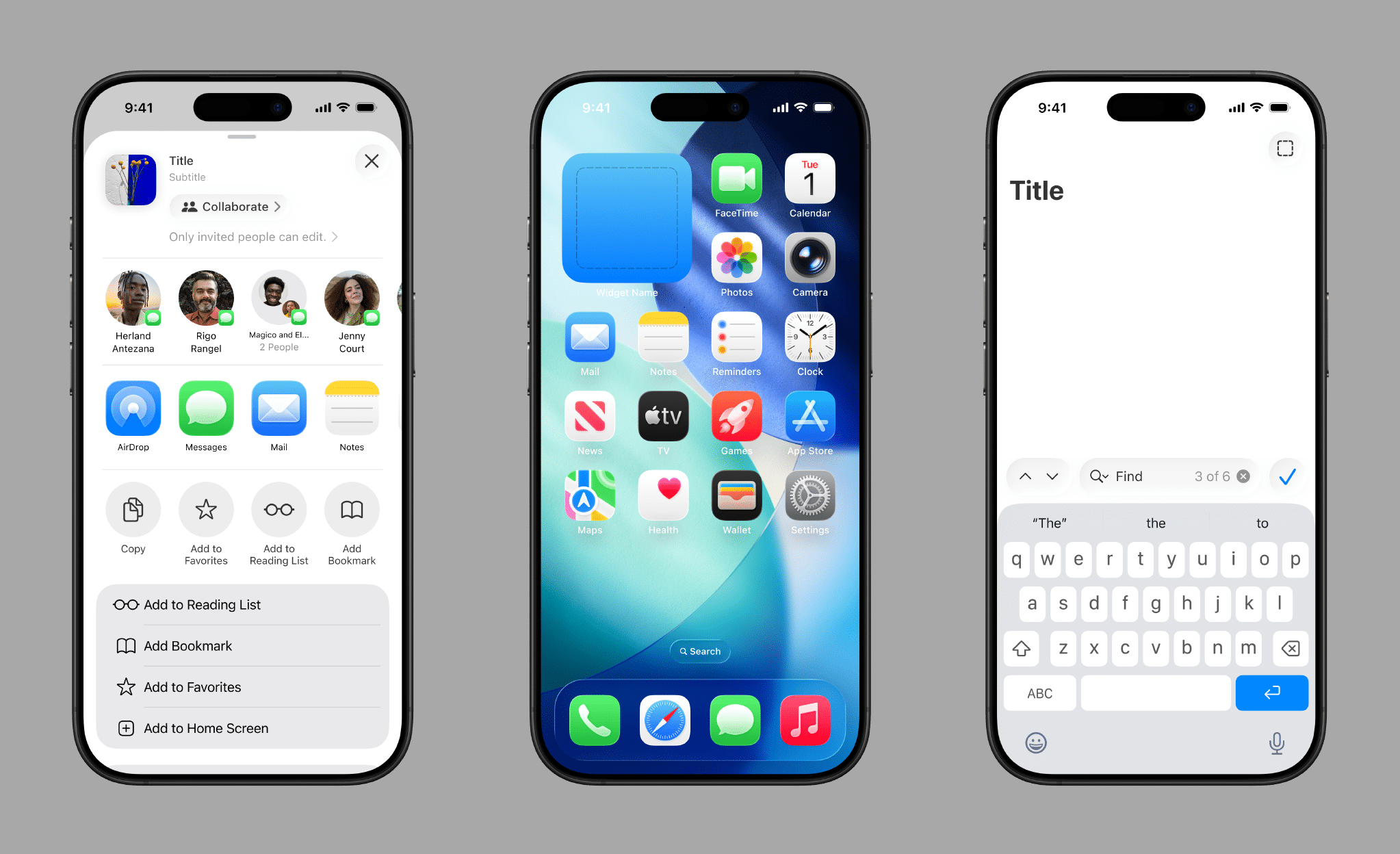

Hoy, Osaurus se conecta de forma flexible con modelos de IA alojados localmente o con proveedores en la nube como OpenAI y Anthropic. Los usuarios eligen libremente qué modelo usar, mientras que otros aspectos —como la memoria, los archivos y las herramientas— permanecen en su propio equipo. Dado que distintos modelos tienen fortalezas diferentes, la ventaja es que se puede cambiar al que mejor se adapte a la tarea.

Esta arquitectura convierte a Osaurus en lo que se conoce como un “harness” (arnés): una capa de control que conecta diferentes modelos, herramientas y flujos de trabajo a través de una sola interfaz. A diferencia de herramientas similares como OpenClaw o Hermes, Osaurus está orientado a consumidores con una interfaz fácil de usar y aborda problemas de seguridad ejecutando todo en una sandbox virtual aislada por hardware, limitando el alcance de la IA y protegiendo el equipo.

Ejecutar modelos de IA en la máquina local aún es una práctica incipiente debido a los intensos requisitos de recursos. Para usar modelos locales, el sistema necesita al menos 64 GB de RAM; para modelos más grandes como DeepSeek V4, Pae recomienda 128 GB de RAM. Sin embargo, el cofundador cree que las necesidades disminuirán con el tiempo: “La inteligencia por vatio está aumentando significativamente. El año pasado la IA local apenas podía terminar frases; hoy puede ejecutar herramientas, escribir código, acceder al navegador y ordenar productos en Amazon”.

Osaurus puede ejecutar modelos como MiniMax M2.5, Gemma 4, Qwen3.6, GPT-OSS, Llama, DeepSeek V4 y otros. También es compatible con los modelos en el dispositivo de Apple, la familia LFM de Liquid AI, y en la nube se conecta con OpenAI, Anthropic, Gemini, xAI/Grok, Venice AI, OpenRouter, Ollama y LM Studio.

Como servidor MCP (Model Context Protocol) completo, Osaurus otorga acceso a cualquier cliente compatible con MCP a sus herramientas. Además, incluye más de 20 plugins nativos para Mail, Calendario, Vision, macOS Use, XLSX, PPTX, Navegador, Música, Git, Sistema de archivos, Búsqueda, Fetch y más. Recientemente, se agregaron capacidades de voz.

El proyecto se presentó públicamente hace casi un año y, según su sitio web, ha sido descargado más de 112,000 veces. Los cofundadores, Terence Pae y Sam Yoo, actualmente participan en la aceleradora de startups Alliance con sede en Nueva York. Están explorando la oferta de Osaurus a empresas, especialmente en los sectores legal y de salud, donde ejecutar LLMs localmente puede resolver problemas de privacidad.

Pae cree que el auge de la IA local podría reducir la demanda de centros de datos: “En lugar de depender de la nube, se puede desplegar un Mac Studio in situ, consumiendo mucha menos energía. Se mantienen las capacidades de la nube, pero sin depender de un centro de datos”.

Con una comunidad creciente y una visión clara, Osaurus se perfila como una solución clave para quienes buscan aprovechar la inteligencia artificial sin sacrificar la privacidad ni el control de sus datos.

Estas buscando algo?

Nuestros Programas:

Al Ritmo de Miami Healthy

Aprende qué comer y cómo vivir mejor para elevar tu bienestar.

Despertando con Claudio María Domínguez

Reflexiones de espiritualidad, bienestar y conciencia Claudio María Domínguez

Misterios Ocultos

OVNIs, enigmas históricos y lo inexplicable contado por expertos.

Inmigrar a Miami

Tu puente a los Estados Unidos Te ayudamos a alcanzar tus sueños americanos con soluciones personalizada.