Parece el comienzo de una película de terror del siglo XXI: tu historial de conversaciones con inteligencia artificial ha sido público todo este tiempo sin que lo supieras. Esta es la cruda realidad que enfrentan usuarios de la nueva aplicación independiente Meta AI, donde miles de personas están publicando involuntariamente sus diálogos privados con el chatbot.

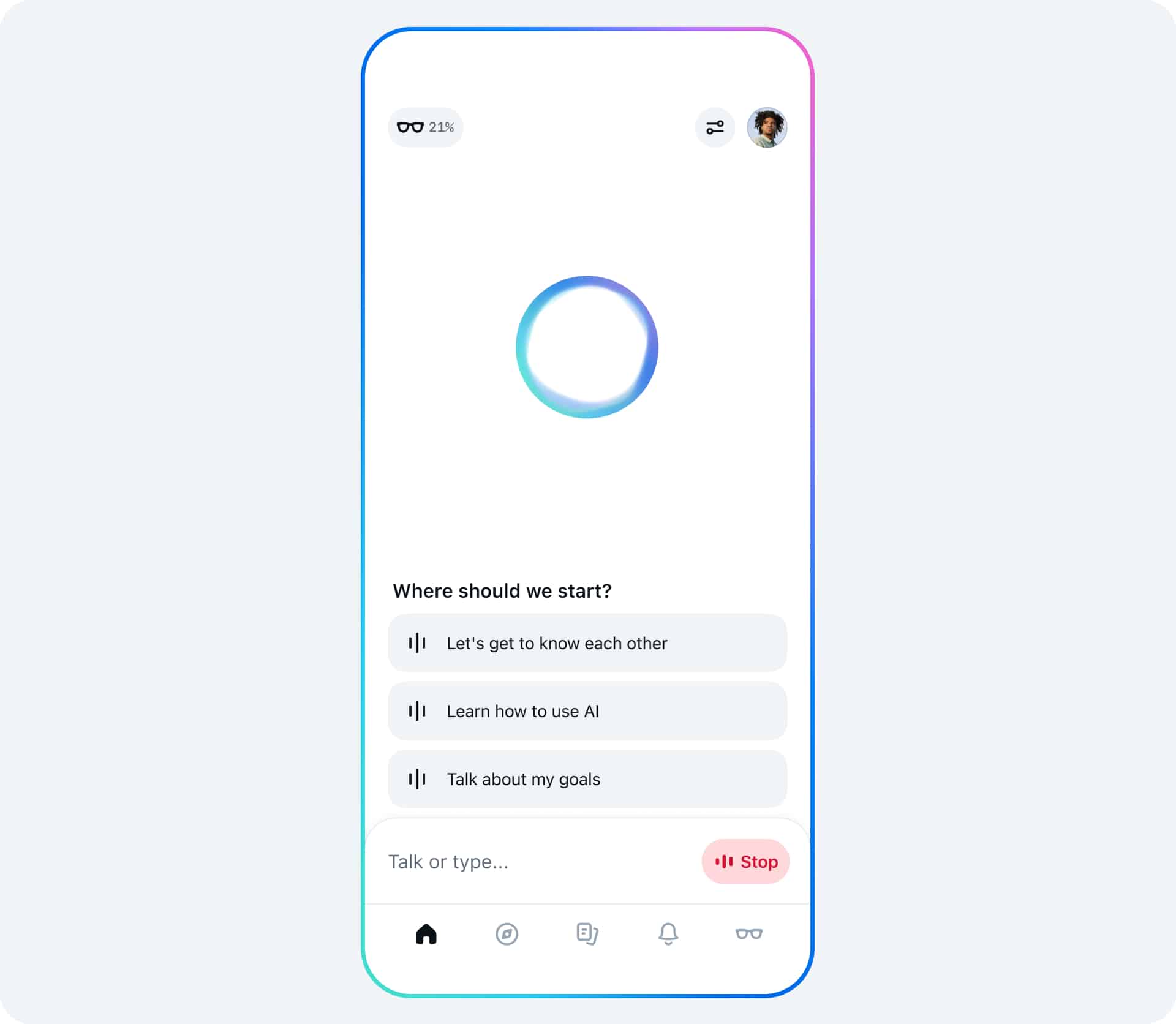

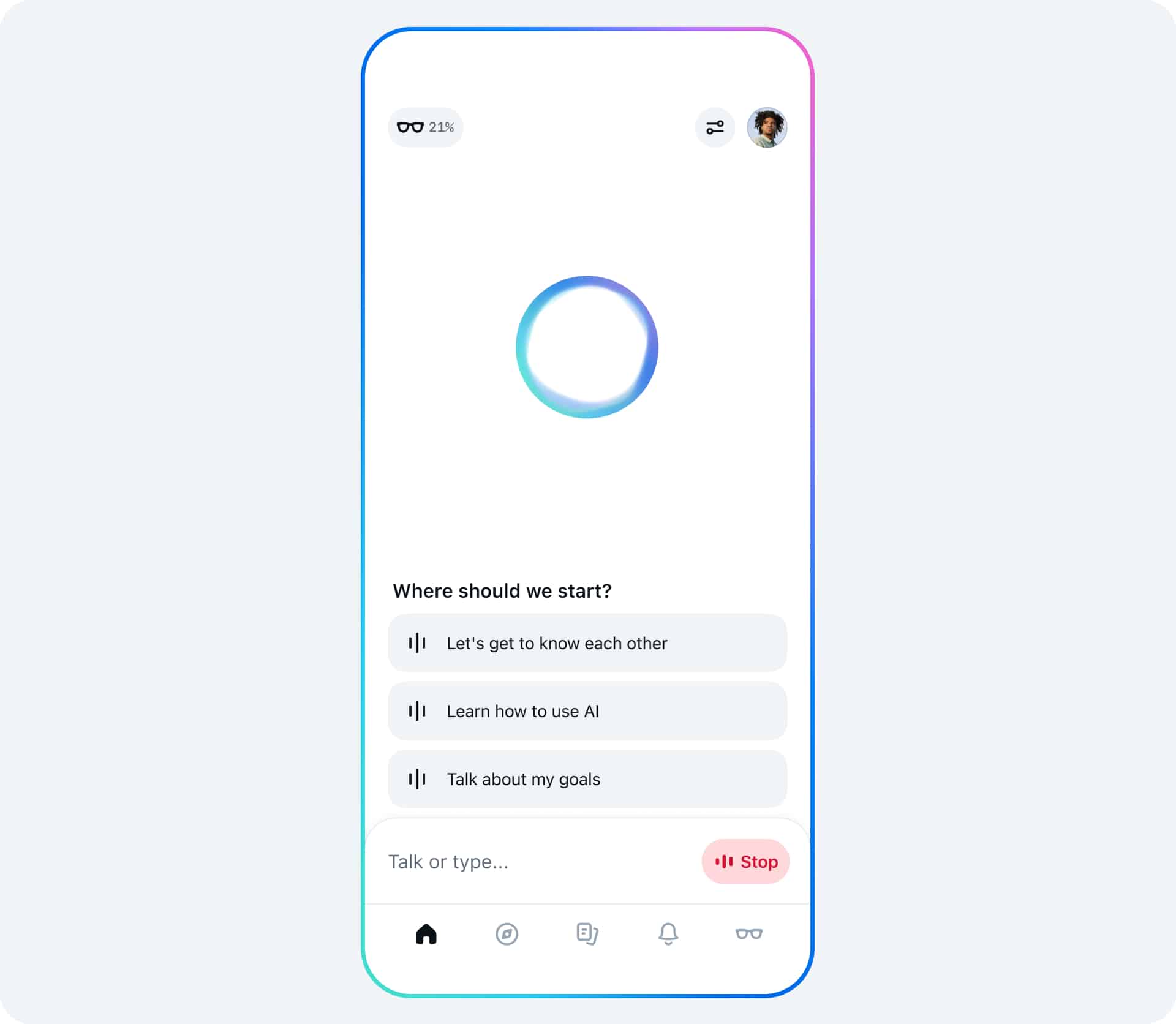

Al realizar una consulta al asistente, los usuarios encuentran un botón de compartir que los lleva a una pantalla de vista previa. El problema radica en que muchos no perciben que al publicar este contenido, sus conversaciones de texto, audios e imágenes quedan expuestas públicamente. Un portavoz de Meta se negó a hacer comentarios al respecto cuando fue contactado.

La experta en seguridad Rachel Tobac documentó casos donde se filtraron datos residenciales y expedientes confidenciales. La situación empeora cuando usuarios inician sesión con cuentas públicas de Instagram, haciendo que todas sus búsquedas hereden esa configuración.

Según datos de la firma de inteligencia Appfigures, la aplicación ha registrado 6.5 millones de descargas desde su lanzamiento el 29 de abril. Pese a ser una cifra considerable para desarrolladores independientes, resulta preocupante para una empresa que ha invertido miles de millones en esta tecnología.

La plataforma ya muestra señales de explotación malintencionada: usuarios publican currículos solicitando empleos en ciberseguridad y guías para crear dispositivos cuestionables. Cada minuto que pasa acerca estas consultas aparentemente inocuas a un desastre viral de proporciones impredecibles.

Estas buscando algo?

Nuestros Programas:

Al Ritmo de Miami Healthy

Aprende qué comer y cómo vivir mejor para elevar tu bienestar.

Despertando con Claudio María Domínguez

Reflexiones de espiritualidad, bienestar y conciencia Claudio María Domínguez

Misterios Ocultos

OVNIs, enigmas históricos y lo inexplicable contado por expertos.

Inmigrar a Miami

Tu puente a los Estados Unidos Te ayudamos a alcanzar tus sueños americanos con soluciones personalizada.