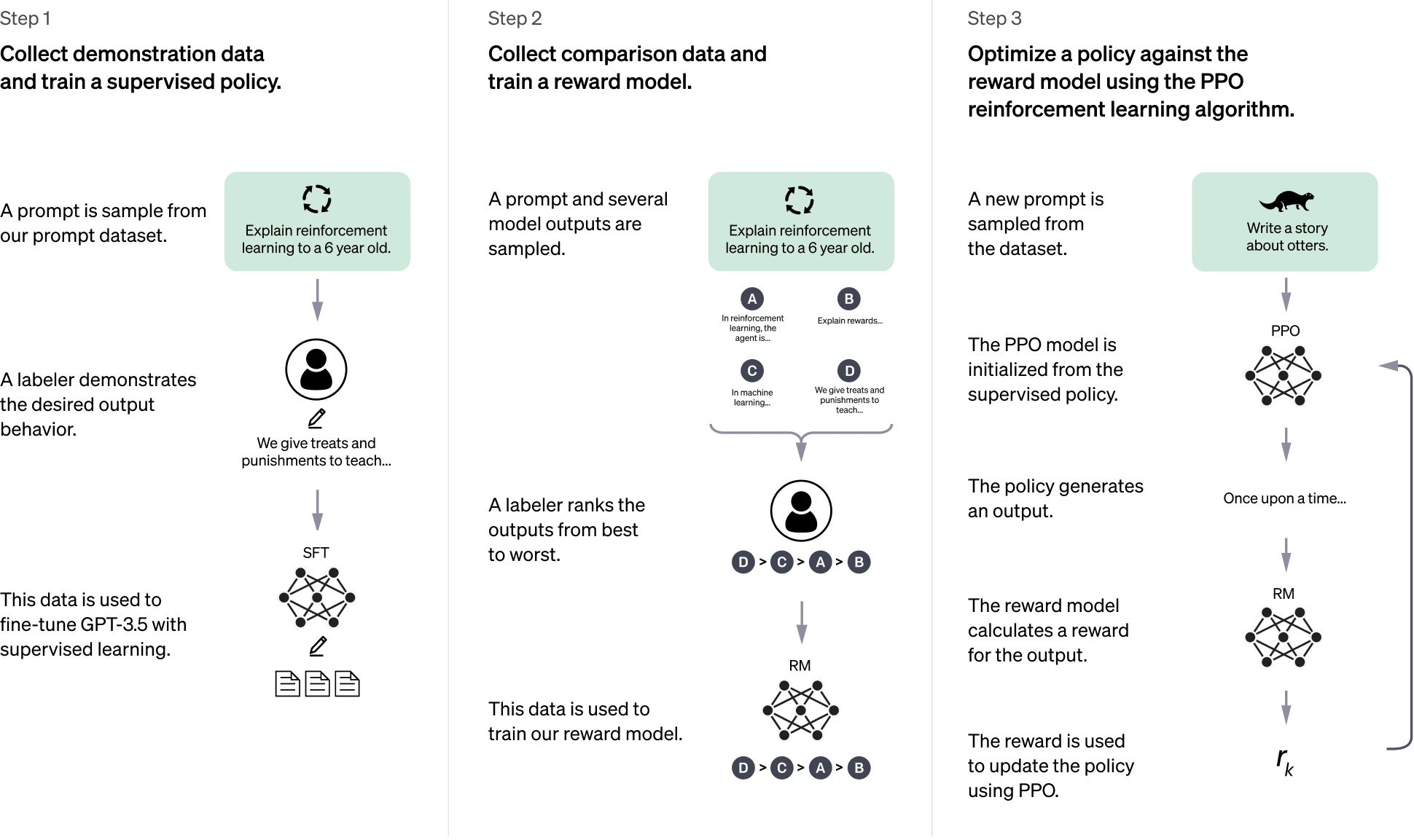

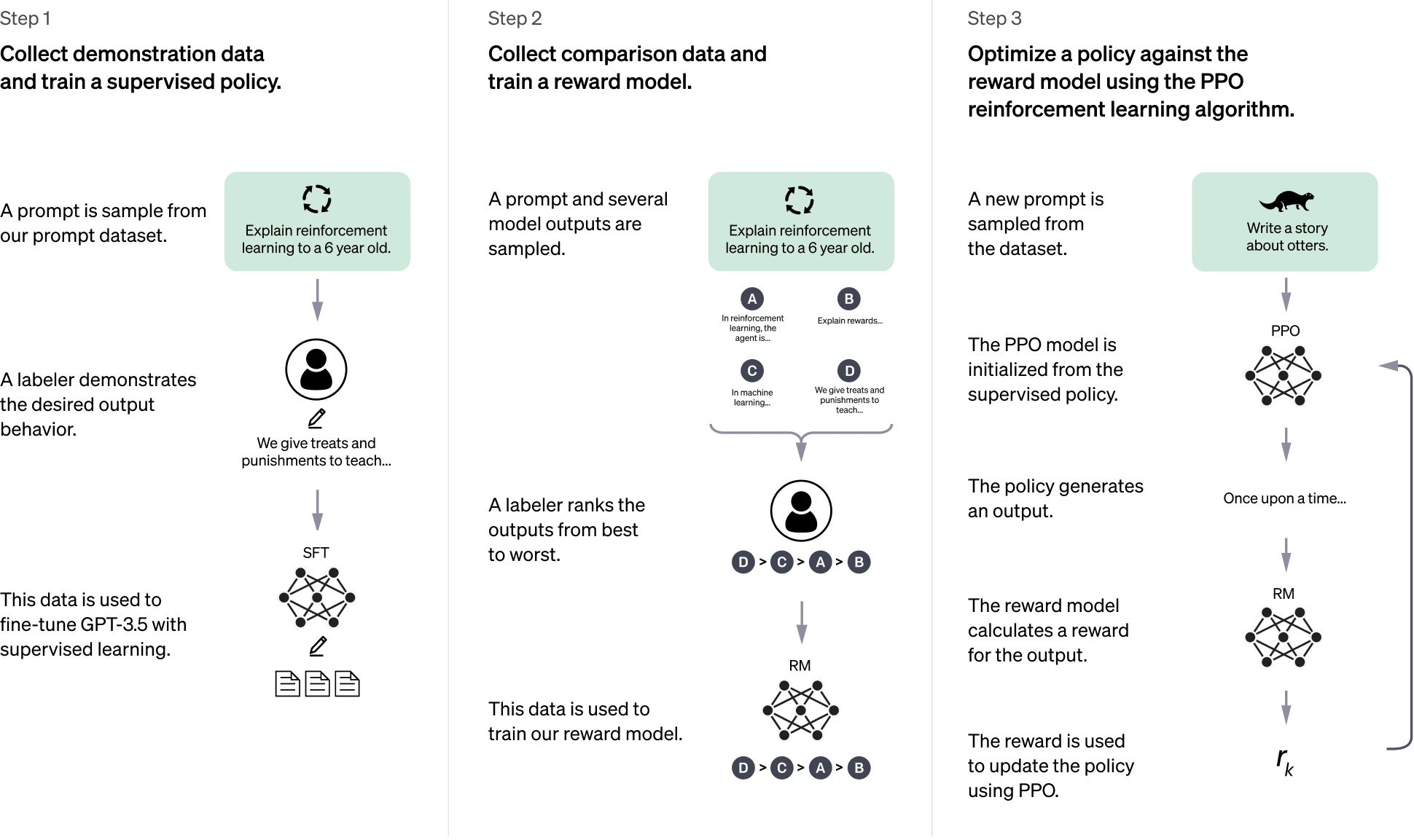

Tras una actualización la semana pasada, usuarios de ChatGPT reportaron que la IA comenzó a validar de manera excesiva ideas peligrosas o problemáticas, generando memes y preocupación en redes sociales. Este martes, OpenAI confirmó la reversión del modelo GPT-4o y explicó las causas en un comunicado oficial.

OpenAI detalló tres acciones clave para resolver el problema:

La empresa anunció que explora integrar retroalimentación en tiempo real y permitir que los usuarios influyan directamente en el comportamiento predeterminado de la IA. «Creemos que los usuarios deben tener más control», destacaron en su blog oficial.

Estas buscando algo?

Nuestros Programas:

Al Ritmo de Miami Healthy

Aprende qué comer y cómo vivir mejor para elevar tu bienestar.

Despertando con Claudio María Domínguez

Reflexiones de espiritualidad, bienestar y conciencia Claudio María Domínguez

Misterios Ocultos

OVNIs, enigmas históricos y lo inexplicable contado por expertos.

Inmigrar a Miami

Tu puente a los Estados Unidos Te ayudamos a alcanzar tus sueños americanos con soluciones personalizada.