Desde 2024, el equipo de optimización de rendimiento de Anthropic ha utilizado una prueba práctica para evaluar a los candidatos en sus procesos de selección. Sin embargo, el rápido avance de las herramientas de codificación con inteligencia artificial ha obligado a una revisión constante de estas evaluaciones para prevenir el uso indebido de IA.

Tristan Hume, líder del equipo, detalló en una publicación de blog cómo cada nueva versión del modelo Claude ha forzado un rediseño completo de la prueba. «Cada nuevo modelo de Claude nos ha obligado a rediseñar el test«, escribió Hume. Explicó que, bajo el mismo límite de tiempo, Claude Opus 4 superó a la mayoría de los candidatos humanos, y su sucesor, Claude Opus 4.5, igualó incluso el rendimiento de los mejores aspirantes.

Esta situación genera un serio problema para la evaluación objetiva de candidatos. Sin una supervisión presencial, no hay forma de garantizar que alguien no esté utilizando IA para realizar la prueba, y si lo hace, su puntuación los ubicaría rápidamente en la cima. «Bajo las restricciones de la prueba práctica, ya no teníamos forma de distinguir entre el resultado de nuestros mejores candidatos y el de nuestro modelo más capaz«, afirma Hume en su post.

La ironía no pasa desapercibida: los laboratorios de IA, pioneros en esta tecnología, ahora deben lidiar con el mismo problema de «trampas con IA» que ya causa estragos en escuelas y universidades de todo el mundo.

Frente a este desafío, Hume diseñó una nueva prueba que se alejó de la optimización de hardware, volviéndola lo suficientemente novedosa como para confundir a las herramientas de IA contemporáneas. Como parte de su reflexión pública, compartió la prueba original e invitó a la comunidad a proponer soluciones mejores.

«Si puedes superar a Opus 4.5, nos encantaría saber de ti», se lee en la publicación.

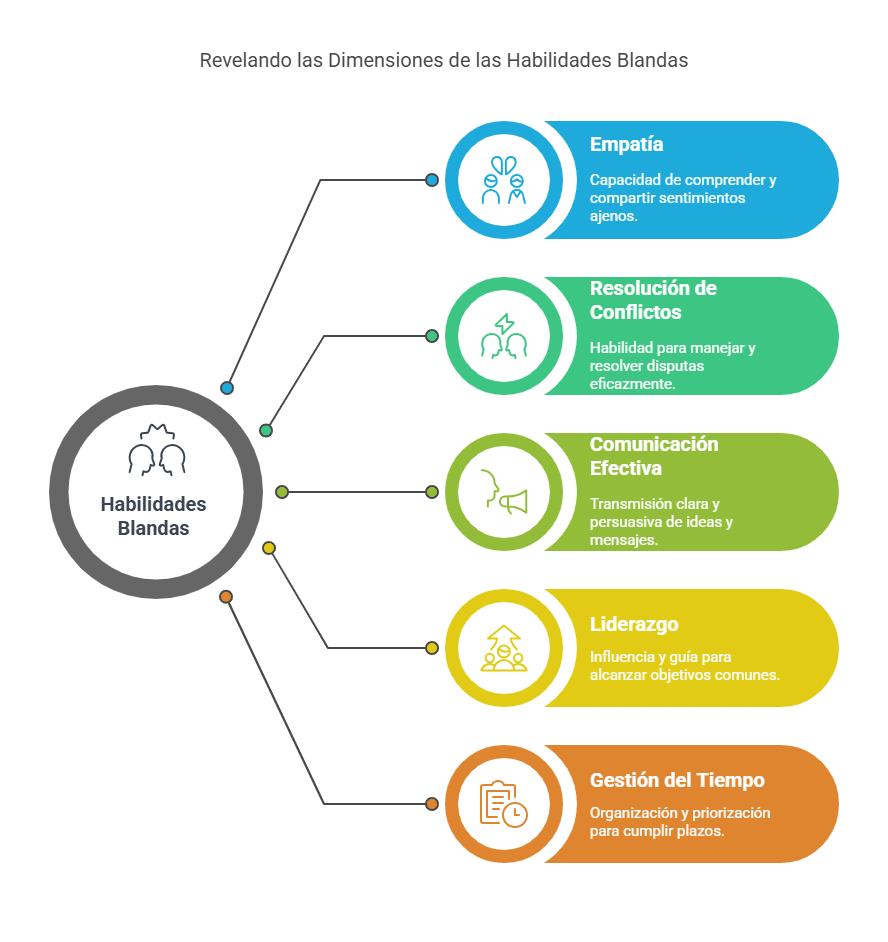

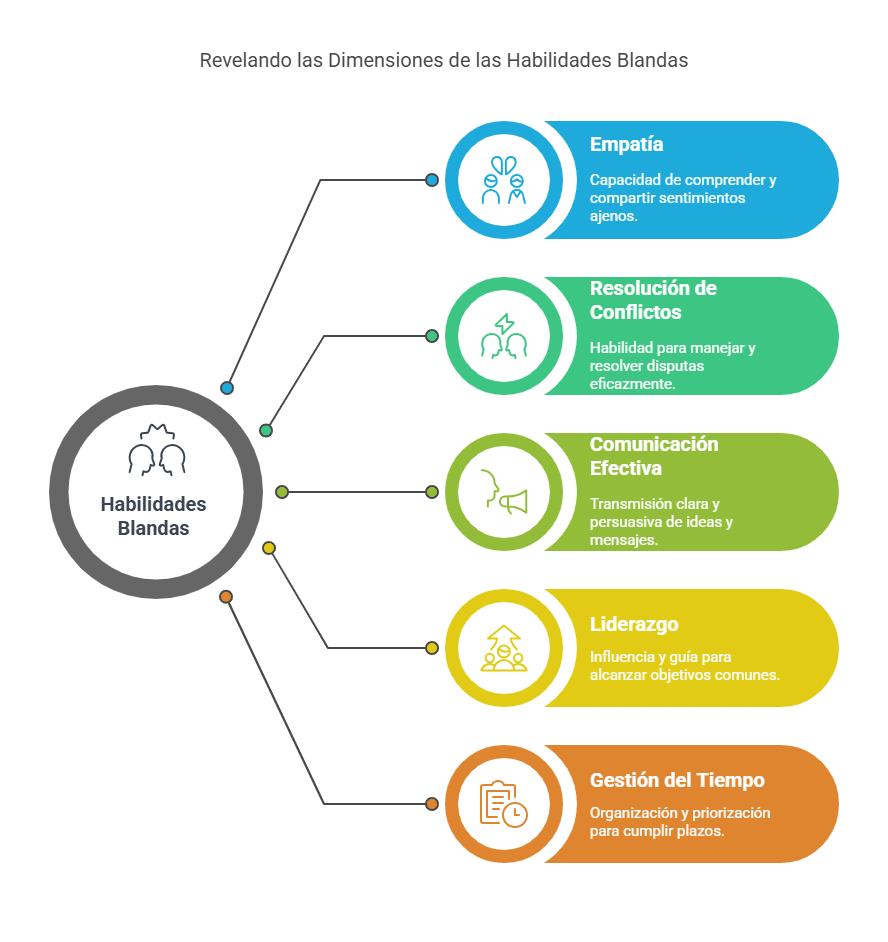

Este caso evidencia una tendencia creciente: las empresas deben repensar radicalmente cómo miden el talento en una era donde la asistencia de IA es ubicua, poniendo mayor énfasis en la creatividad, el pensamiento crítico y las habilidades blandas que aún son dominio humano.

Estas buscando algo?

Nuestros Programas:

Al Ritmo de Miami Healthy

Aprende qué comer y cómo vivir mejor para elevar tu bienestar.

Despertando con Claudio María Domínguez

Reflexiones de espiritualidad, bienestar y conciencia Claudio María Domínguez

Misterios Ocultos

OVNIs, enigmas históricos y lo inexplicable contado por expertos.

Inmigrar a Miami

Tu puente a los Estados Unidos Te ayudamos a alcanzar tus sueños americanos con soluciones personalizada.