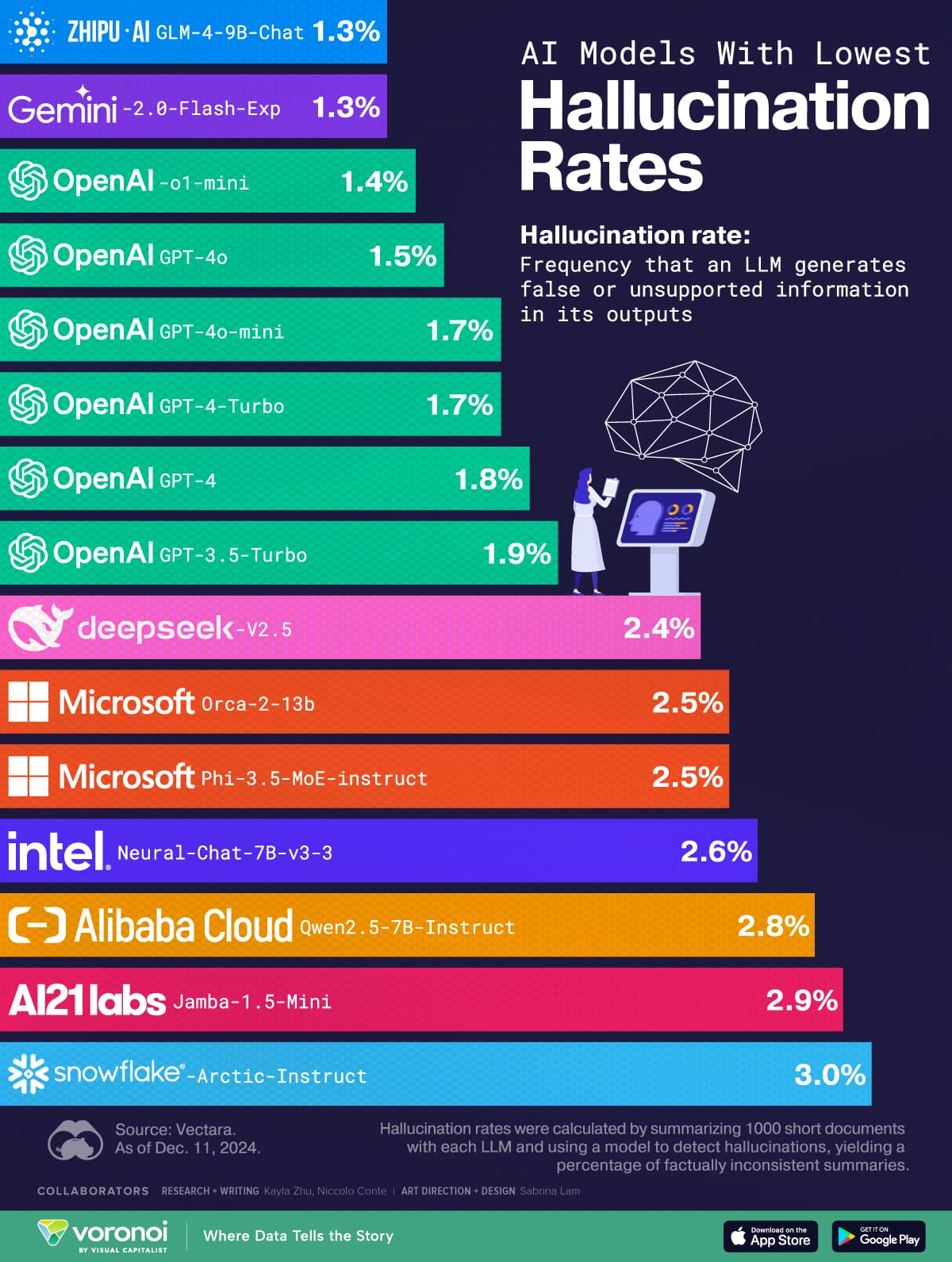

En un evento para desarrolladores de Anthropic celebrado este jueves 22 de mayo de 2025 en San Francisco, el CEO Dario Amodei lanzó una afirmación contundente: «Los modelos actuales de IA probablemente alucinen menos que los humanos».

Mientras líderes como Demis Hassabis de Google DeepMind ven las alucinaciones como «agujeros críticos», Amodei argumenta que:

«No existen barreras duras que limiten lo que la IA puede lograr. El agua sube por todas partes»

La polémica continúa: ¿Puede considerarse AGI a una IA que alucina? Amodei sugiere que sí, siempre que sus errores sean comparables a los humanos.

Estas buscando algo?

Nuestros Programas:

Al Ritmo de Miami Healthy

Aprende qué comer y cómo vivir mejor para elevar tu bienestar.

Despertando con Claudio María Domínguez

Reflexiones de espiritualidad, bienestar y conciencia Claudio María Domínguez

Misterios Ocultos

OVNIs, enigmas históricos y lo inexplicable contado por expertos.

Inmigrar a Miami

Tu puente a los Estados Unidos Te ayudamos a alcanzar tus sueños americanos con soluciones personalizada.